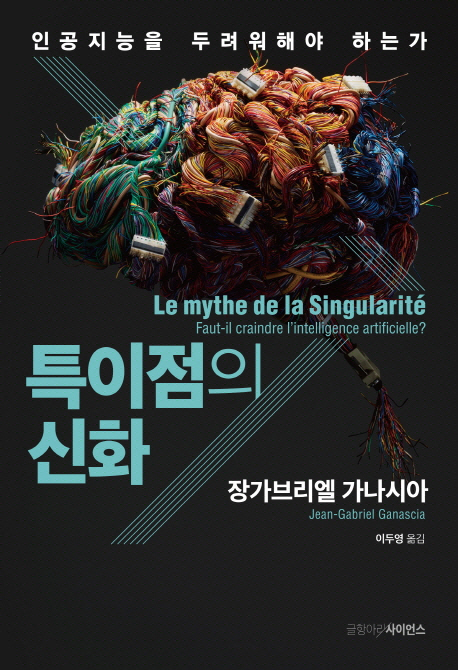

매순간 기계는 스스로를 만들어내고 성장한다. 당장은 이해할 수 없겠지만 특정한 한순간이 지나면 인공지능(AI)이 인간을 삼켜버리게 된다. 이 특정한 한순간이 기계가 인간의 능력을 초월하는 기술적 특이점(Singularity)이다. 하지만 파리6대학 정보과학 교수로 인공지능 연구팀을 20년간 이끌어온 전문가는 “특이점 이론은 SF 소설에나 나올만한 말”이라고 일축했다. 최근 2년 사이 스티븐 호킹, 빌 게이츠 등이 경고했던 AI의 위협이 틀렸다는 주장이다. 왜 그럴까.

특이점의 제창자 레이 커즈와일은 2045년경 슈퍼인텔리전스가 출현할 것이라 예상했다. 이때 예상의 근거가 바로 ‘무어의 법칙’이다. 인텔의 공동 창업자인 고든 무어가 1960년대 발표한 이 법칙은 프로세서의 기능이 지수함수적으로 발표한다는 법칙이다. 실제로 어떤 유형의 집적회로에서 트렌지스터의 수는 24개월마다 안정적으로 두 배로 늘었고, 이에 따라 컴퓨터의 성능, 처리 속도, 기억 용량도 두 배가 됐다. 가격이 절반으로 떨어진 것은 덤이다.

하지만 저자는 무어의 법칙이 경험칙을 공식화한 것에 불과하다고 지적한다. 논리학에서 ‘귀납적 추론’이라 불리는 이 방식은 과학적으로 유효하기 위해 증명 과정이 필요하지만, 기술의 발전은 진화 직전 상태에서 재현해 낼 수 없기 때문이다. 시간을 거꾸로 돌릴 수 없는 것과 마찬가지의 이치다.

또한 ‘자연과학’에서 블랙홀과 같은 특이점에 가까워질수록 통상의 법칙이 적용되지 않는 점도 지적했다. 자석의 N극과 N극은 서로 밀어내야 정상이지만 조그마한 원자핵과 같은 곳에서는 양성자끼리 같은 극인데도 전자기력을 이겨내고 ‘강한 핵력’을 통해 서로 붙어 있게 되는 것과 비슷한 이치다. 또한 저자는 마이크로프로세서가 여전히 실리콘과 반도체로 제조되고 있다는 점도 환기한다. 반도체 소자는 기능을 완수하기 위해 수백개의 실리콘 원자가 포함돼야 하는 만큼 아무리 작게 만들어도 10nm(나노미터)를 밑돌 수 없다. 이는 현재의 마이크로프로세서 발전 속도가 절대 줄어들지 않을 것이라는 추론에 대한 결정적인 반례다.

저자는 특이점 신화 뒤에는 구글과 같은 대기업이 존재한다고 주장한다. 그에 따르면 대기업이 ‘특이점’을 주장하는 이유는 정치에 있다. 이 문제에 관해 점점 힘을 잃어가는 국가와 시민사회를 대신해 거대 디지털 기업이 국가의 통제를 벗어나 새로운 게임의 규칙을 결정하고 싶어한다는 것이다. 1만5,000원

/우영탁기자 tak@sedaily.com

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >

tak@sedaily.com

tak@sedaily.com