“한국이 소버린(자립형) 인공지능(AI) 경쟁력을 강조하고 있는데 이를 위해서는 ‘설명 가능한 AI(XAI)’ 기술 확보가 시급합니다.”

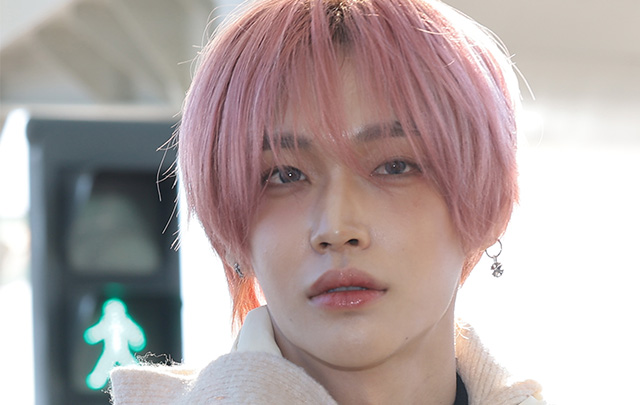

이수인 미국 워싱턴대 컴퓨터공학과 교수는 제3회 세계한인과학기술인대회가 열린 8일 서울 강남구 한국과학기술회관에서 국내 언론과 인터뷰를 갖고 “AI는 반도체처럼 오랜 역사를 갖고 단단하게 구축된 학문이 아니기 때문에 사람이 기술 원리를 이해하고 설명할 수 있게 만들어져야 한다”며 AI 정확도 연구 수준이 글로벌 기술패권 경쟁의 관건이 될 것이라고 강조했다.

한국 정부는 AI 3강 도약을 목표로 외세에 의존하지 않는 국산 모델, 이른바 소버린 모델 개발을 포함해 이에 필요한 그래픽처리장치(GPU)와 데이터센터 등 AI 인프라 구축에 집중하고 있다. 하지만 이렇게 만들어진 소버린 AI 모델이 높은 정확도를 담보함으로써 실제 일상에서 믿고 쓰일 수 있으려면 관련 기초과학 분야인 설명 가능한 AI 역시 정부의 집중 지원이 필요하다는 게 한국계 글로벌 AI 석학의 생각이다.

이 교수는 삼성그룹 호암재단이 1991년부터 사회발전을 위해 탁월한 업적을 이룬 한국계 전문가에게 시상해온 ‘삼성호암상’ 제정 이래 여성 최초로 공학상을 받았다. 그는 한국과학기술원(KAIST) 전자공학과를 졸업하고 미국 스탠퍼드대에서 전기공학 박사 학위를 받았다. 스탠퍼드대 재학 당시 AI 4대 석학이자 같은 학교 교수인 앤드류 응 교수의 머신러닝(기계학습) 수업을 수강하며 1등 성적표를 받고 이후 그와 함께 논문을 쓰기도 했다. 졸업 후 연구현장에서 현재까지 설명 가능한 AI에 주력하고 있다. 이 교수는 이 분야에서 ‘샤플리 가산 설명(SHAP) 프레임워크’라는 세계적으로 인정받는 방법론을 만들었고 국제 학술지 ‘네이처 바이오메디컬 엔지니어링’에 표지 논문을 발표하는 등 학문적 성과를 내고 있다.

통상 AI의 사고과정은 제대로 알 수 없어 ‘블랙박스’에 비유되지만 이를 투명하게 설명하고 AI가 어떤 판단을 내릴지 예측하는 기술이 설명 가능한 AI다. 딥페이크, 가짜뉴스(허위정보), 혐오·편향 발언, 저작권 침해, 개인정보 유출 등 부작용에 맞서 AI 신뢰성을 높이기 위해 반드시 필요한 기술이다. 이 교수는 “가령 피부 사진을 찍어 피부암을 판별해주는 AI 서비스를 생각해보면 피부암이 아닌데 암으로 판별하거나 반대로 오류를 내는 경우가 있다”며 “SHAP은 AI의 인풋, 즉 입력된 피부 사진에서 어느 부분이 잘못된 결론을 내리는지를 밝혀내는 방법론”이라고 설명했다.

이 교수는 “2016년에 의사들과 마취로 인한 부작용인 저산소증 발생을 예측하려던 시도가 설명 가능한 AI 연구의 계기가 됐다”며 “마취 때문에 사람이 죽는 경우도 생기기 때문에 설명 가능한 AI라는 분야를 통해 AI와 바이오를 융합하면 응용 가능성이 무궁무진하다고 판단했다”고 전했다. 그의 말대로 피부암이나 저산소증 예측뿐 아니라 구글 ‘제미나이’나 퍼플렉시티AI의 ‘퍼플렉시티’ 등 일상적 대형언어모델(LLM)이 잘못된 답변을 하는 할루시네이션(환각) 문제를 해결하는 데도 설명 가능한 AI가 폭넓게 쓰일 수 있다.

설명 가능한 AI가 글로벌 AI 경쟁에서 이처럼 중요한 요소인 만큼 한국 역시 관련 투자가 필요한 실정이다. 한국의 관련 연구 수준을 묻는 질문에 이 교수는 “한국을 떠난 지 오래돼서 정확히 모른다”면서도 “한국은 과학기술을 우대하는 정도가 개선돼야 할 부분이 많다고 본다”고 에둘러 지적했다. 설명 가능한 AI는 AI 모델 개발과 같은 응용 분야가 아닌 기초과학 분야인 만큼 현재 한국의 기초과학 홀대 기조에 영향을 받을 수밖에 없다는 취지다.

이 교수는 그러면서 “(전 정부의) 연구개발(R&D) 예산 삭감으로 굉장히 어려워 하는 한국 연구자들을 많이 봤다”며 “연구가 발전하고 두뇌 유출을 막으려면 장기적 관점에서 꾸준한 펀딩(투자)가 이뤄져야 한다”고 강조했다. 그는 “설명 가능한 AI는 수학이나 게임이론 같은 전통적인 이론을 기반으로 한다”며 “이 같은 이론적 바탕이 탄탄해야 경쟁력을 갖출 수 있다”고 말했다. 그의 연구팀이 만든 SHAP 말고도 다양한 설명 가능한 AI 방법론이 경쟁하는 상황인 만큼 한국 역시 진정한 소버린 AI 확보를 위해서는 이 분야 연구 주도권이 필요하다는 취지다.

이 교수는 이 같은 기술 우위를 앞세워 알츠하이머(치매) 정복에 도전하고 있다. 바이오 AI가 질병을 어떻게 예측하는지를 사람이 설명할 수 있다는 것은 곧 그 질병의 원인을 알 수 있다는 의미이기 때문이다. 이 교수는 “알츠하이머는 미국에서 죽음을 야기하는 질병 상위 10위권에 드는 데도 아직 제대로 된 치료제가 없는 상황”이라며 “만약 AI가 특정 유전자 문제로 알츠하이머가 발병한다고 결론을 내렸다면 우리는 설명 가능한 AI를 활용해 그 발병 원인을 설명할 수 있고 그 자체가 새로운 생명과학적 지식이 된다”고 설명했다.

이 교수는 최근 한국 정부의 AI 정책 방향에 대해서는 “(하정우) AI 미래기획수석을 임명하는 등 AI를 국가적으로 서포트하는 모습은 굉장히 바람직하다”며 “소버린 AI 전략 역시 찬성하지만 그렇다고 외산 모델은 무조건 안 된다는 식의 ‘클로즈드(폐쇄적) 마인드’는 지양해야 한다”고 조언했다.

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >

sookim@sedaily.com

sookim@sedaily.com